AI dokázala podvádět to nejlepší, co lidstvo nabízí poté, co objevilo exploit v klasické arkádové hře Q * bert a běželo s ním.

Zatímco dřívější iterace AI by správně hrály Q * bert, v určitém okamžiku svého učení o tom, jak hra funguje, objevuje exploit, který jí umožňuje shromáždit šílené body. Přirozeně, jako by to dělal každý hráč na skóre, opakuje postup, aby mohl zvýšit své skóre nejefektivnějším možným způsobem.

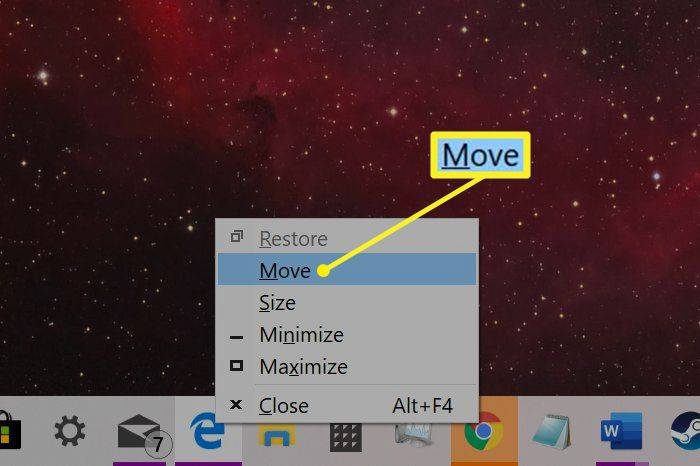

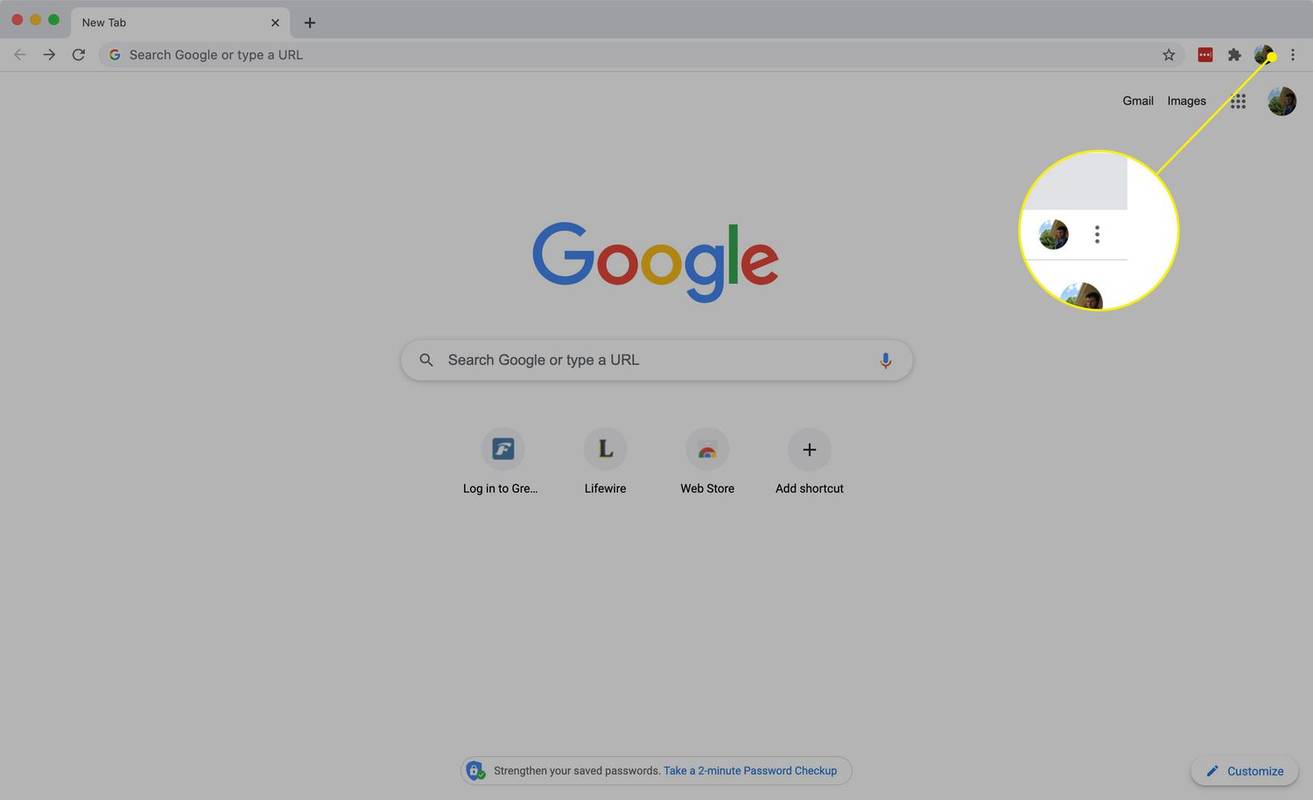

Na níže uvedeném videu můžete vidět AI, která se pohybuje kolem platforem. Nejprve to vypadá, jako by to bezcílně skákalo mezi platformami. Místo toho, aby viděl, jak hra postupuje do dalšího kola, se Q * bert zasekne ve smyčce, kde začnou blikat všechny její platformy - zde může AI poté pokračovat v šílenství a získávat obrovské body.

PŘEČTĚTE SI DALŠÍ: Jeden z nejkontroverznějších herních záznamů byl nakonec zdiskreditován

jak přeměnit dokument na jpeg

Jak AI vyhrála Q * bert válku

Díky rekordnímu rekordu všech dob dosáhla AI díky programování algoritmu evoluční strategie neuvěřitelně vysokého skóre. Evoluční strategie (ES) se liší od obvyklého učení posílení (RL), které tradiční AI používá, protože je díky svému generačnímu učení považováno za škálovatelnější.

Každá učební smyčka se označuje jako generace a pokračuje ve své úloze, dokud není splněna stanovená podmínka (v tomto případě vysoké skóre). S každou další generací umělá inteligence absorbuje znalosti předchozí generace, a proto lépe dosahuje stejného cíle a překonává ho. Pokračujte a skončíte s AI, která je ve svém úkolu naprosto bezkonkurenční. Přesně to se tu stalo s Q * bert skóre.

Nastínil v papír , publikovaný minulý týden vědci na univerzitě ve Freiburgu v Německu, se zdá, že chyba nebyla známým množstvím. Ve skutečnosti, když nejsou příliš překvapeni, když našli chybu, je zajímavé sledovat, jak AI poté pokračovala a naučila se ji využívat pokaždé, když hrála, aby maximalizovala svůj bodovací potenciál.

PŘEČTĚTE SI DALŠÍ: Tato umělá inteligence se učí zvládat Super Mario Bros

Aby našli chybu, musel se agent nejprve naučit téměř dokončit první úroveň - nedělo se to najednou, ale pomocí mnoha drobných vylepšení, vysvětlili vědci Registrace . Máme podezření, že v určitém okamžiku výcviku narazilo jedno z řešení pro potomky na chybu a získalo mnohem lepší skóre ve srovnání se svými sourozenci, což zase zvýšilo jeho příspěvek k aktualizaci - jeho váha byla nejvyšší ve váženém průměru. To pomalu přesunulo řešení do prostoru, kde stále více potomků začalo narážet na stejnou chybu.

Neznáme přesné podmínky, za kterých se chyba objevuje; je možné, že se objeví, pouze pokud agent postupuje podle vzorce, který se zdá být neoptimální, [například když agent ztrácí čas nebo dokonce ztrácí život]. Pokud by tomu tak bylo, pak by bylo pro standardní RL extrémně těžké najít chybu: pokud použijete přírůstkové odměny, naučíte se strategie, které rychle přinášejí nějakou odměnu, místo toho, abyste se naučili strategie, které na chvíli nepřinášejí mnoho odměn, a pak najednou vyhrajte.

Viz související Šampión dragsterů Todd Rogers právě přišel o korunu po 35 letech Tato umělá inteligence se učí zvládat Super Mario Bros 1-2 po dobu 17 dnů Sledujte, jak se tato AI učí řídit v GTA V na Twitchi

Navzdory skvělým výsledkům robota však vědci neříkají, že je to případ, kdy je třeba prosazovat učení ES nad RL. Ve skutečnosti mají oba systémy své vlastní problémy a kombinace těchto dvou systémů je do značné míry považována za nejlepší variantu vpřed.

Stejná metoda ES na jiných hrách Atari nepřinesla ani zdaleka stejné pozitivní výsledky. Na druhou stranu je RL zodpovědná za rozbíjení záznamů vlevo, vpravo a na střed, včetně bití nejlepšího hráče GO na světě. ES má stále ve věcech své vlastní místo a je to vlastně způsob, jakým Nvidia provádí spoustu školení AI, protože vyžaduje větší výpočetní výkon, ale dosahuje lepších výsledků po delší dobu.

Bez ohledu na to, jakým způsobem se stane budoucnost vývoje AI, přinejmenším tento robot podvádějící systém není tak špatný jako tento nyní zneuctěný mistr světa videoher .